Kalibrierungspipeline

Kurzfassung (TL;DR):

Wir stellen eine geometrische Kamera-Kalibrierungspipeline bereit, die Monitore als aktive Ziele verwendet, wobei ein einziges Ziel für alle Kameratypen ausreicht. Sie liefert hochgradig konsistente, wiederholbare und reproduzierbare Ergebnisse mit einer Dekodierungsunsicherheit von bis zu 10 µm.Unterstützt gängige OpenCV-Kameramodelle sowie unser eigenes freiform-Kameramodell, das sich für jede Art von Optik eignet.Einfache Integration über Docker oder eine C++-Bibliothek. Die Pipeline läuft auf CPU oder GPU (CUDA / Metal) – entweder direkt auf dem Gerät oder serverseitig.

Monitor als Kalibrierungsziel

Eine naheliegende Möglichkeit, einen Monitor als Kalibrierungsziel zu verwenden, besteht darin, beliebige Muster darauf anzuzeigen: ChArUco-Boards, Schachbrettmuster, Kreisgitter oder andere benutzerdefinierte Designs. Der gleiche Bildschirm kann verschiedene Zieltypen darstellen, auf jede gewünschte Größe skaliert, während gleichzeitig die Geometrie und das Verhalten des Kalibrierungsmusters vollständig kontrolliert werden. Prinzipiell könnte ein dynamisches Display viele statische Kalibrierungsziele ersetzen.

Warum ist dies noch nicht zum Standardansatz geworden? Tatsächlich ist es das in vieler Hinsicht bereits. Die Fertigungsqualität moderner Monitore ist für viele Anwendungen ausreichend hoch: Die Pixelgeometrie ist stabil und klar definiert, und die Ebenheit des Bildschirms ist für präzise Arbeiten geeignet. In praktischen Szenarien kann die erreichbare Dekodierungsunsicherheit das Niveau von einigen Dutzend Mikrometern erreichen (siehe unser Experiment)

Ein weiteres mögliches Problem bei der Verwendung eines Monitors ist der Moiré-Effekt. Die Kamera kann teilweise die Subpixelstruktur oder das schwarze Raster zwischen den Display-Pixeln auflösen, was die Dekodierung des Musters stören kann. Dieses Problem lässt sich effektiv beheben, indem Bilder mit einer leichten Defokussierung aufgenommen werden. In diesem Bereich bleibt das Kalibrierungsmuster klar sichtbar, während die hochfrequente Pixelstruktur und damit auch die Moiré-Artefakte unscharf werden.

Daher ist die Verwendung eines Monitors als Kalibrierungsziel nicht nur möglich, sondern für eine Vielzahl von präzisen Kalibrierungsaufgaben vollkommen legitim.

Methode der aktiven Ziele (MAT)

Wir haben bereits besprochen, dass eine Kamera mit bekannten statischen Mustern wie Schachbrettmustern kalibriert werden kann. Wenn jedoch ein Monitor als Ziel verwendet wird, haben wir vollständige Kontrolle darüber, was angezeigt wird. Dadurch können wir die dynamische Natur des Bildschirms nutzen und deutlich mehr Informationen gewinnen, als mit statischen Mustern möglich ist.

Statische Muster leiden unter mehreren inhärenten Einschränkungen:

- Fokussierungsanforderung. Das Muster muss scharf fokussiert sein (oder sehr nahe daran). Andernfalls verschlechtert sich die Lokalisierung der Merkmale. Gleichzeitig können Moiré-Effekte auftreten, wenn die Kamera zu gut auf das Pixelraster fokussiert ist, aufgrund von Interferenzen zwischen den Pixelstrukturen des Sensors und des Displays.

- Diskrete Pixelstruktur. Die Geometrie gedruckter oder angezeigter Referenzpunkte (z. B. Schachbrettecken) ist an das Pixelraster des Monitors gebunden. Die endliche Pixelgröße und die dunklen Zwischenräume zwischen den Pixeln führen zu Verzerrungen und erhöhen die Unsicherheit bei der Dekodierung.

- Randverluste. Referenzpunkte in der Nähe der Bildschirmränder sind oft nur teilweise sichtbar oder verzerrt und werden daher von Erkennungsalgorithmen ignoriert, was zu einer systematischen Unterabtastung an den Rändern führt.

- Abhängigkeit von der Monitorpixelgröße. Bei der Verwendung diskreter Merkmale (z. B. Schachbrettecken) ist die erreichbare Lokalisierungsgenauigkeit grundsätzlich durch den Pixelabstand des Monitors und die Kontraststruktur einzelner Pixel begrenzt. Selbst bei Subpixel-Verfeinerung beeinflusst die Monitorpixelgröße die untere Grenze der erreichbaren Unsicherheit.

Können diese Einschränkungen überwunden werden? Ja. Eine Lösung wurde in der optischen Metrologie vorgeschlagen, eine aktuelle Beschreibung findet sich in [1]. Die strukturierte Beleuchtung zeigt einen grundlegend anderen Ansatz: Anstatt einzelne Merkmalspunkte zu erkennen, zeigt der Bildschirm eine Folge phasenverschobener Kosinusmuster.

Warum dies die Qualität verbessert

1. Keine diskreten Referenzpunkte

Es gibt keine isolierten „Merkmale“, deren Geometrie von Pixelkanten abhängt. Stattdessen liefert der gesamte Bildschirm Informationen. Jeder Pixel wird kontinuierlich und gleichmäßig kodiert.

2. Subpixelgenauigkeit über den Pixelabstand des Displays hinaus

Obwohl das Display diskret ist, basiert die Phasenschätzung auf einer intensitätsbasierten Messung. Die Phase kann mit einer Genauigkeit geschätzt werden, die weit unter einem Displaypixel liegt, hauptsächlich begrenzt durch:

- Signal-Rausch-Verhältnis

- Kamera-Rauschen

- Optische Unschärfe

Dies beseitigt die starke Abhängigkeit von der Monitorpixelgröße, unter der statische Muster leiden.

3. Keine Randausgrenzung

Da die Kodierung über die gesamte sichtbare Fläche kontinuierlich erfolgt, erstrecken sich die nutzbaren Daten bis an die Bildschirmränder (außer einem minimalen Rand aufgrund von Filterung oder Sichtbarkeitsgrenzen).

4. Reduzierte Verzerrung durch Pixelstruktur

Da die Phase aus mehreren Bildern extrahiert und über räumliche Nachbarschaften gemittelt wird, werden hochfrequente Artefakte wie das Subpixelraster des Displays oder kleine Intensitätsinhomogenitäten weitgehend unterdrückt.

5. Quantifizierbare Unsicherheit

Das Phasenrauschen kann analytisch aus dem Intensitätsrauschen vorhergesagt werden (wie in der zitierten Arbeit gezeigt). Dies ermöglicht die Schätzung der Dekodierungsunsicherheit pro Pixel, was für die metrologische Kalibrierung äußerst wertvoll ist.

6. Der Fokus wird weniger kritisch

Leichte Unschärfe kann tatsächlich vorteilhaft sein: Sie unterdrückt Moiré-Artefakte, die durch Interferenzen zwischen dem Pixelraster des Displays und dem Kamerasensor entstehen, während die glatten Kosinusmuster auch bei moderater Unschärfe robust bleiben. Im Gegensatz dazu verschlechtern sich Schachbrettecken und andere scharfe geometrische Merkmale bereits bei geringfügiger Unschärfe des Bildes schnell, was zu einer geringeren Lokalisierungsgenauigkeit führt.

Dies bietet einen praktischen Vorteil bei der Kalibrierung von Kameras, die für lange Arbeitsabstände ausgelegt sind. Mit phasenverschobenen Kosinusmustern muss die Kamera nicht perfekt auf das Kalibrierungsziel fokussiert sein. Tatsächlich kann sie absichtlich leicht unscharf gestellt werden, um Artefakte des Pixelrasters zu unterdrücken, ohne die Dekodierungsgenauigkeit zu beeinträchtigen.

Infolgedessen kann die Kalibrierung in deutlich kürzeren Entfernungen als der nominalen Brennweite des Objektivs durchgeführt werden. In einem unserer Experimente haben wir erfolgreich eine Kamera, die für eine Brennweite von 10 Metern konfiguriert war, kalibriert, während die Kalibrierungsdaten nur in 1,5 Metern Entfernung erfasst wurden. Trotz der starken Unschärfe blieb die resultierende Kalibrierungsqualität hoch.

ML-inspirierter Kalibrierungsansatz

Wir behandeln die Kamerakalibrierung als ein maschinelles Lernproblem: Das Kameramodell wird „trainiert“, um eine optimale Leistung auf einem gegebenen Datensatz zu erreichen.

Der Kalibrierungsworkflow folgt Prinzipien, die im maschinellen Lernen üblich sind. Modellanpassung und Bewertung erfolgen auf getrennten Datensätzen, und die Modellkomplexität wird so gewählt, dass weder Unteranpassung noch Überanpassung entsteht. Abhängig von den Anwendungsanforderungen können wir entweder klassische parametrische Modelle (wie in OpenCV implementiert) oder flexiblere Modelle wie unser Freiformmodell einsetzen, das in der Lage ist, komplexe optische Systeme zu beschreiben.

Zur Bewertung der Kalibrierungsqualität verwenden wir metrologisch orientierte Metriken, die über die einfache Übereinstimmung zwischen Modell und Kalibrierungsdaten hinausgehen. Insbesondere bewerten wir:

- Konsistenz – wie gut das kalibrierte Modell die Kalibrierungsdaten erklärt;

- Reproduzierbarkeit – wie stabil die Ergebnisse bleiben, wenn die Kalibrierung mit unabhängig gesammelten Daten wiederholt wird;

- Zuverlässigkeit – die erwartete Messunsicherheit, wenn das kalibrierte Modell in realen Anwendungsszenarien verwendet wird.

Diese Metriken entsprechen auf natürliche Weise Konzepten aus dem maschinellen Lernen wie Trainingsverlust, Generalisierungsfähigkeit und Unsicherheitsabschätzung.

Die Modellvalidierung erfolgt mittels K-facher Kreuzvalidierung. Die gesammelten Positionen werden in mehrere Teilmengen aufgeteilt, und mehrere Kalibrierungen werden mit unterschiedlichen Trainings-/Testaufteilungen durchgeführt. Für stabile Modellklassen (wie unsere Freiformmodelle) können die resultierenden Modelle gemittelt werden, um eine robuste Endschätzung zu erhalten. Für weniger stabile parametrische Modelle (wie OpenCV-Modelle) wählen wir die Kalibrierungsinstanz aus, die die beste Validierungsleistung zeigt.

Neue Qualitätsmetriken

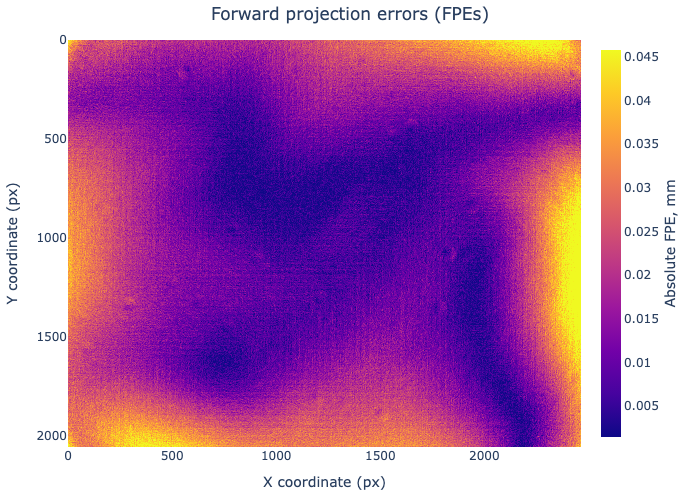

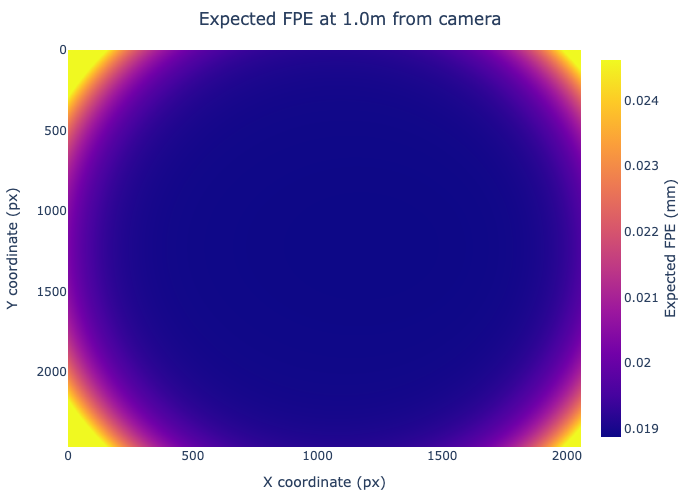

Zusätzlich zu klassischen Validierungsmetriken wie dem Reprojektionsfehler (RPE) und dem RMS-Fehler verwenden wir zwei ergänzende Maße: den Forward Projection Error (FPE) und den Expected Forward Projection Error (EFPE).

Beide Metriken können verwendet werden, um verschiedene Kameras miteinander zu vergleichen, wenn eine Kamera ausgewählt werden soll, die am besten für ein gegebenes Anwendungsszenario geeignet ist. Da FPE und erwarteter FPE in physikalischen Einheiten der 3D-Welt und nicht in Pixeln ausgedrückt werden, liefern sie eine direkte Schätzung, wie genau das kalibrierte Kameramodell die Positionen der Sichtstrahlen im Raum vorhersagt. Dadurch ist es möglich, die geometrische Leistung verschiedener Kameras, Objektive oder Kalibrierungsmodelle in Begriffen zu bewerten und zu vergleichen, die direkt für Messungen in der realen Welt relevant sind.

Beispielsweise beschreiben erwartete FPE-Karten die Unsicherheit der Sichtstrahlenlokalisierung, die durch Unsicherheiten in den kalibrierten Modellparametern induziert wird. Diese Werte können auf jeden Arbeitsabstand übertragen werden und ermöglichen somit die Schätzung der erwarteten geometrischen Fehler in einem spezifischen Anwendungsszenario. Dadurch können Kameras objektiv verglichen werden, indem ihre vorhergesagte 3D-Messgenauigkeit innerhalb des vorgesehenen Sichtfeldes und Arbeitsabstands bewertet wird.

FPE bewertet die Abweichung direkt in der 3D-Welt, indem die dekodierten Zielkoordinaten mit der Schnittmenge der vorhergesagten Sichtstrahlen und der Kalibrierungsebene verglichen werden. Im Gegensatz zum pixelbasierten RPE wird FPE in physikalischen Einheiten (z. B. Millimeter, Mikrometer) ausgedrückt, was es direkt interpretierbar für metrologische Anwendungen macht.

EFPE quantifiziert wiederum den erwarteten Forward Projection Error, der durch Unsicherheiten in den kalibrierten Modellparametern verursacht wird. Er übersetzt die Kovarianzmatrix der intrinsischen Modellparameter in vorhergesagte 3D-Lokalisierungsunsicherheiten auf einer vordefinierten Fläche und liefert damit ein physikalisch sinnvolles Maß für die Zuverlässigkeit des Modells in nachgelagerten Messungen.

Zusammen ermöglichen diese Metriken nicht nur die Bewertung der Konsistenz mit den Kalibrierungsdaten, sondern auch die Abschätzung der erwarteten Leistung des kalibrierten Kameramodells in realen Anwendungsszenarien.

Mehr Stabilität und Genauigkeit mit einem Freiformmodell

Für maximale Leistung haben wir ein fortschrittliches multiparametrisches Freiform-Kalibrierungsmodell entwickelt. Dieses Modell ist in der Lage, subtile optische Effekte und feinmaßstäbliche geometrische Abweichungen zu erfassen, die von klassischen parametrischen Modellen (wie „Pinhole + mehrere polynomiale Verzerrungen“) nicht dargestellt werden können.

Infolgedessen werden die Fehlerebenen über den gesamten Sensorbereich deutlich gleichmäßiger — die typische Abweichung zwischen Bildzentrum und Ecken wird reduziert. Das Modell liefert ein konsistentes Fehlerverhalten über das gesamte Sichtfeld, was insbesondere in hochpräzisen metrologischen Anwendungen wichtig ist.

Aus Datensicht kann das Modell als dichtes Mapping interpretiert werden (effektiv eine strukturierte Lookup-Tabelle), die jedem Kamerapixel einen kalibrierten 3D-Sichtstrahl zuweist. Es ist optik-agnostisch; insbesondere unterstützen einige Versionen nicht-zentrale Projektionsgeometrien. Dies bedeutet, dass es Multi-Element-Optiken, geneigte Sensorsysteme oder komplexe Linsensysteme genau darstellen kann, ohne ein einziges effektives Pinhole zu benötigen.

Aufgrund seiner Flexibilität und Dimensionalität ist dieses Modell nicht direkt mit Standardframeworks wie OpenCV oder MATLAB kompatibel, die auf kompakte parametrische Darstellungen angewiesen sind. Daher stellen wir spezielle Bibliotheken und Werkzeuge zur Verfügung, um mit diesem Modell zu arbeiten, einschließlich effizienter Routinen für Strahlauswertung, Bildentzerrung, Reprojektion und Integration in nachgelagerte Vision- oder Metrologie-Pipelines.

Mehr Stabilität und Genauigkeit mit einem Freiformmodell

Für maximale Leistung haben wir ein fortschrittliches multiparametrisches Freiform-Kalibrierungsmodell entwickelt. Dieses Modell ist in der Lage, subtile optische Effekte und feinmaßstäbliche geometrische Abweichungen zu erfassen, die von klassischen parametrischen Modellen (wie „Pinhole + mehrere polynomiale Verzerrungen“) nicht dargestellt werden können.

Infolgedessen werden die Fehlerebenen über den gesamten Sensorbereich deutlich gleichmäßiger — die typische Abweichung zwischen Bildzentrum und Ecken wird reduziert. Das Modell liefert ein konsistentes Fehlerverhalten über das gesamte Sichtfeld, was insbesondere in hochpräzisen metrologischen Anwendungen wichtig ist.

Aus Datensicht kann das Modell als dichtes Mapping interpretiert werden (effektiv eine strukturierte Lookup-Tabelle), die jedem Kamerapixel einen kalibrierten 3D-Sichtstrahl zuweist. Es ist optik-agnostisch; insbesondere unterstützen einige Versionen nicht-zentrale Projektionsgeometrien. Dies bedeutet, dass es Multi-Element-Optiken, geneigte Sensorsysteme oder komplexe Linsensysteme genau darstellen kann, ohne ein einziges effektives Pinhole zu benötigen.

Aufgrund seiner Flexibilität und Dimensionalität ist dieses Modell nicht direkt mit Standardframeworks wie OpenCV oder MATLAB kompatibel, die auf kompakte parametrische Darstellungen angewiesen sind. Daher stellen wir spezielle Bibliotheken und Werkzeuge zur Verfügung, um mit diesem Modell zu arbeiten, einschließlich effizienter Routinen für Strahlauswertung, Bildentzerrung, Reprojektion und Integration in nachgelagerte Vision- oder Metrologie-Pipelines.

Beispiel unserer Kalibrierung

Um die bestmöglichen Kalibrierungsergebnisse zu überprüfen, haben wir in unserem Experiment eine 5MP-Industriekamera MAKO G-507 B von Allied Vision Technologies kalibriert. Sie besitzt einen monochromen CMOS-Sensor mit einer Diagonale von 11,1 mm, eine Auflösung von 2464 × 2056 Pixeln (d. h. der Pixelabstand beträgt 3,45 μm × 3,45 μm) und zeichnet Daten mit einer Bildtiefe von 12 Bit auf. Die Kamera ist mit einem 16-mm-LINOS-MeVis-C-Objektiv gekoppelt.

Während der Kalibrierung haben wir Daten aus 34 Kamerapositionen gesammelt. An jeder Position blieb die Kamera statisch, während der Bildschirm eine Sequenz codierter Muster durchlief: ChArUco und MAT.

| Szenario | Datenquelle | Referenzpunkte | Punktrauschen (µm) | Kameramodell | RMS RPE (px) | RMS FPE (µm) | Zentrales Ergebnis |

|---|---|---|---|---|---|---|---|

| Szenario I (Baseline) | ChArUco | 6364 | ~130 µm | OpenCV- Standardmodell | 0.68 | 85 | Hochwertige Standardkalibrierung |

| Szenario II | MAT (subsampled) | ~8M | ~17 ± 10 µm | OpenCV- Standardmodell | 0.23 | 33 | Deutlich stabilere Kalibrierung, keine Ausreißerregionen |

| Szenario III | MAT | ~8M | ~17 ± 10 µm | Freiformmodell | 0.21 | 28 | Extrem gleichmäßige Übereinstimmung zwischen Modell und Daten |

Wesentliche Verbesserungen

| Übergang | RPE-Verbesserung | FPE-Verbesserung | Hauptgrund |

|---|---|---|---|

| Szenario I → II | ~3× geringer | ~2,6× geringer | Deutlich präzisere Zielmessungen (MAT vs. CharUCO) |

| Szenario II → III | Leichte Verbesserung | Leichte Verbesserung | Flexibleres Kameramodell |

Messqualität der Targets

| Target-Typ | Geschätztes Rauschen |

|---|---|

| CharUCO-Ecken | ~130 µm |

| MAT-dekodierte Positionen | ~17 ± 10 µm |

| MAT-Dekodierungsgrenze (Designziel) | ~10 µm |

Es gibt zwei zentrale Erkenntnisse: Die größten Verbesserungen bei RPE/FPE entstehen durch bessere Messdaten durch aktive Targets, und das Freiform-Kameramodell verbessert hauptsächlich die Stabilität und Gleichmäßigkeit der Kalibrierung, anstatt die globalen Metriken drastisch zu reduzieren.

Kalibrierungsgeschwindigkeit

Die Geschwindigkeit der Kalibrierung ist der zweite zentrale Parameter, auf den wir uns neben der Kalibrierungsqualität konzentrieren.

Abhängig von den Anforderungen der Anwendung kann die Kalibrierung eine oder mehrere Posen umfassen, wobei pro Pose mehrere Frames aufgenommen werden. Der rechnerische Teil der Kalibrierungspipeline selbst ist sehr effizient und läuft problemlos selbst auf moderaten GPUs. Unter idealen Bedingungen kann die gesamte Laufzeit der Kalibrierung nahe an die Zeit für die Datenerfassung heranreichen.

In der Praxis wird die Gesamtleistung des Systems jedoch von zusätzlichen Faktoren beeinflusst, wie zum Beispiel:

- Die Umschaltzeit des Monitors zwischen angezeigten Mustern

- Belichtungszeit und Bildrate der Kamera

- Datenübertragungsbandbreite zwischen Kamera und Verarbeitungssystem

Um eine optimale Leistung zu erreichen, wenden wir mehrere Strategien an:

- Einzel-Pose-Kalibrierungsansatz. In einigen Szenarien kann die Kalibrierung aus einer einzigen Pose durchgeführt werden (dies kann zusätzliche Hardwarekomponenten oder kontrollierte Anpassungen des Setups erfordern).

- Reduzierung der Frames pro Pose. Die Anzahl der phasenverschobenen Frames kann abhängig vom erforderlichen Genauigkeitsniveau angepasst werden.

- Kontrollierte Umgebung. Die Stabilisierung von Beleuchtung, mechanischem Aufbau und Fokus reduziert das Rauschen und ermöglicht weniger Frames pro Pose, ohne die Qualität zu beeinträchtigen.

- Mehrkamerakalibrierung. Mehrere Kameras können gleichzeitig mit demselben Monitor kalibriert werden, was den Durchsatz in Produktionsumgebungen erheblich erhöht.

Um zuverlässige Schätzungen der erreichbaren Leistung für ein bestimmtes Setup zu liefern, simulieren wir den gesamten Kalibrierungsprozess. Dadurch können wir Aufnahmezeit, Rechenlast, Engpässe und Skalierbarkeit bereits vor dem Einsatz vorhersagen.

Integration

In seiner einfachsten Form wird die Kalibrierungspipeline als eigenständige Softwarekomponente (C++) bereitgestellt, die über eine API zugänglich ist. Sie läuft auf CPU oder GPU (CUDA für NVIDIA, Metal für Apple-Plattformen) und verwendet einen gewöhnlichen Flachbildmonitor als aktives Kalibrierungsziel.

Für fortgeschrittenere Szenarien kann das System als serverseitige Lösung (mit Docker-Unterstützung) bereitgestellt werden, die auf einer Multi-GPU-Infrastruktur für Umgebungen mit hohem Durchsatz läuft. Hardware-Setups können großformatige Displays (z. B. 85-Zoll-Panels) umfassen, die mechanisch mit Aluminiumrahmen verstärkt sind, um geometrische Stabilität zu gewährleisten, oder einen Micro-LED- bzw. iPad-Bildschirm verwenden. Die Pipeline kann auch für FPGA-Implementierungen angepasst werden, wenn maximale Geschwindigkeit erforderlich ist, oder direkt auf Geräten eingesetzt werden: zum Beispiel zur Ermöglichung einer Selbstkalibrierung auf dem Gerät in Flotten von Smartphones oder verteilten Kamerasystemen.

Das zentrale Prinzip ist Flexibilität: Es gibt keine einzelne feste Konfiguration der Kalibrierungspipeline. Ihre endgültige Architektur wird an die spezifische Aufgabe, die Leistungsanforderungen und die verfügbare Hardware angepasst. Unsere Lösung ist modular und anpassbar und gewährleistet ein optimales Gleichgewicht zwischen Genauigkeit, Geschwindigkeit, Skalierbarkeit und Integrationsanforderungen.

Simulation

Um praktische Fragen zu beantworten, wie die endgültige Lösung aussehen wird, welches Genauigkeitsniveau zu erwarten ist, wie Hardware und Integration gestaltet werden sollten und welche Leistung erreicht werden kann, ist einer unserer Schlüssel Schritte die Simulation.

Wir simulieren die gesamte Kalibrierungspipeline mit physikalisch-genauen Rendering-Tools wie Mitsuba. In diesen Simulationen modellieren wir die spezifischen Kameras, erzeugen synthetische Kalibrierungsdaten unter realistischen Bedingungen (einschließlich Optik, Rauschen, Unschärfe und Geometrie) und führen dann das vollständige Kalibrierungsverfahren auf den simulierten Daten durch.

Dies ermöglicht uns:

- Vorhersage der erreichbaren Genauigkeit vor der Hardwarebereitstellung

- Bewertung der Robustheit unter realistischem Rauschen und Umgebungsbedingungen

- Vergleich verschiedener Kameramodelle und Kalibrierungsstrategien

- Optimierung des Kalibrierungssetups (Displaygröße, Entfernungen, Anzahl der Posen, Musterparameter)

- Schätzung der Rechenleistung und Skalierbarkeit

Durch diese End-to-End-virtuelle Validierung können wir das Kalibrierungsdesign im Voraus anpassen und Risiken, Integrationszeit und unerwartete Leistungseinschränkungen im realen System erheblich reduzieren.

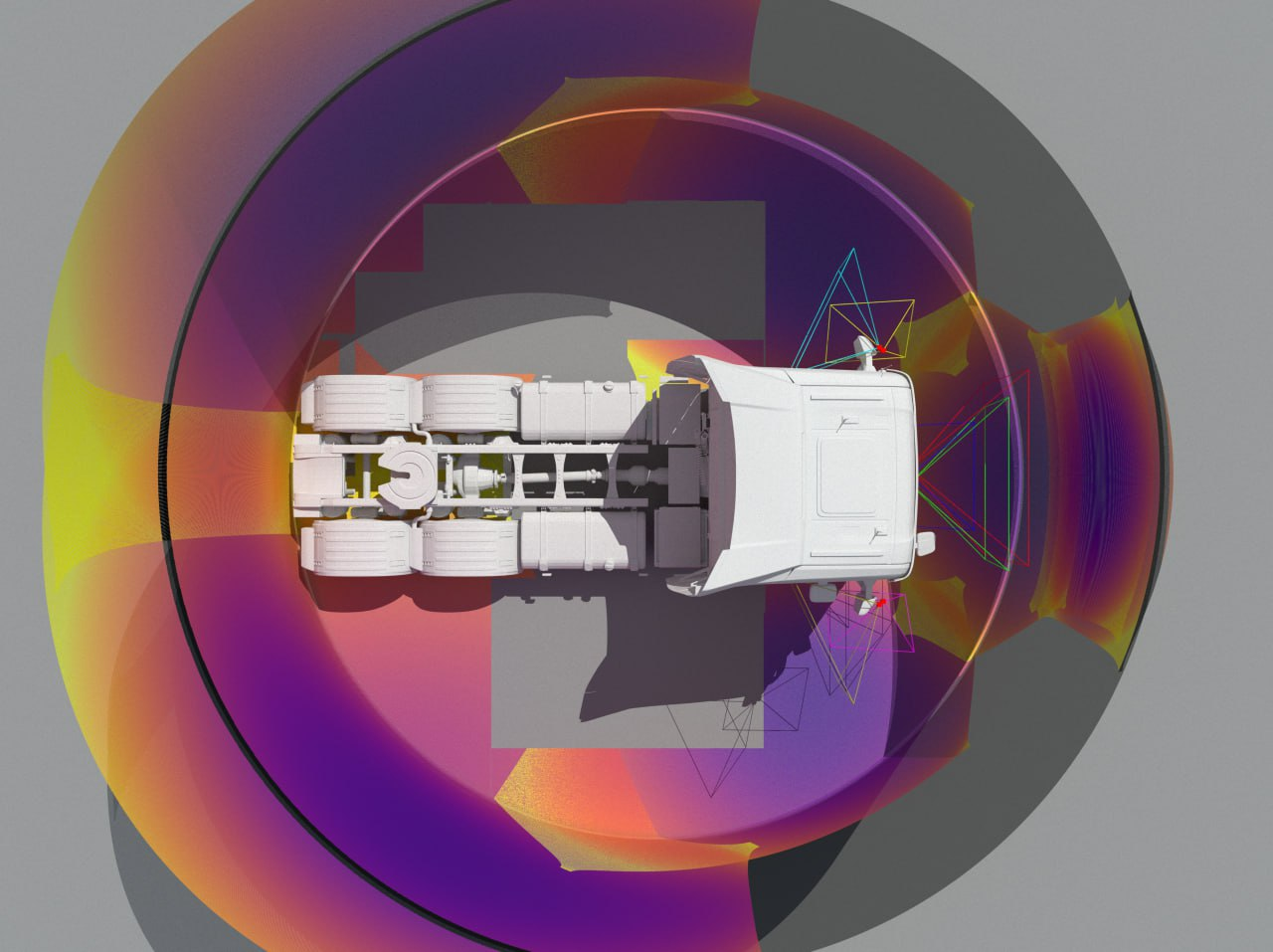

Für fortgeschrittene Szenarien können wir auch hochrealistische visuelle Simulationen in Unreal Engine bereitstellen. Diese Simulationen ermöglichen es uns, realistische, interaktive Umgebungen zu präsentieren, die den Kalibrierungsworkflow, das Systemverhalten und die erwartete Leistung klar demonstrieren – besonders nützlich bei der Kommunikation mit Stakeholdern oder Entscheidungsträgern.

Während unsere physikbasierten Simulationen auf quantitative Genauigkeit und Validierung fokussiert sind, bieten Unreal Engine-Visualisierungen eine intuitive und visuell überzeugende Darstellung der Lösungsarchitektur und ihrer Auswirkungen.

Beste Kalibrierung auf dem Markt?

Wir sind der Ansicht, dass diese Frage keine universelle Antwort hat, da die optimale Kalibrierungslösung immer vom spezifischen zu lösenden Problem abhängt.

Wenn die Kalibrierungsgeschwindigkeit das primäre Ziel ist, kann es oft sinnvoll sein, etwas Genauigkeit zugunsten eines höheren Durchsatzes zu opfern. In solchen Fällen sind klassische Ansätze, zum Beispiel ein ChArUco-Board, oft die praktischste und effizienteste Option.

Unsere Kalibrierungspipeline sollten Sie jedoch in Betracht ziehen, wenn Sie:

- Verschiedene Kameratypen kalibrieren und Kosten für physische Kalibrierungsziele reduzieren möchten

- Hohe Kalibrierungsqualität, Konsistenz, Wiederholbarkeit und Reproduzierbarkeit benötigen

- Metrologische Genauigkeit mit physikalisch interpretierbaren Unsicherheitsabschätzungen erfordern

- Mit Kameras arbeiten, die nicht adäquat durch Standard-Parametermodelle beschrieben werden können (unser Freiformmodell adressiert solche Fälle)

- Wenig Platz haben und Kameras mit langer Brennweite in kürzeren Entfernungen kalibrieren müssen

- Eine zuverlässige Einzel-Pose-Kalibrierungslösung benötigen

Kurz gesagt, die richtige Lösung hängt davon ab, ob Ihre Priorität maximale Geschwindigkeit oder maximales Vertrauen in die geometrische Genauigkeit Ihres Systems ist.

Kontaktformular

Laborprotokoll

Wissenschaftliche Arbeiten

[1] Fischer, M., Petz, M., & Tutsch, R. (2012). Vorhersage des Phasenrauschens in optischen Messsystemen mit strukturierter Beleuchtung. In Proceedings of the 16th GMA/ITG Conference “Sensoren und Messsysteme 2012”, pp. 374–385. DOI: https://doi.org/10.5162/sensoren2012/3.4.2